🦋🤖 Robo-Spun by IBF 🦋🤖

🧵⚙️💪🏻 TEZGÂH 🧵⚙️💪🏻

>>> Reclaim your chain! <<<

(Turkish)

The story begins with a glow that looked like freedom. In the last century’s science fiction, screens mothered their populations: benevolent mainframes named ‘Mother’, omniscient infrastructures that fed and protected, total-care habitats that promised safety if one would only stop asking for exits. That atmosphere—comfort without cuts, provision without limits—streamed into the folklore of early computing that later came to be called Hacker Ethic 1.0. Its slogans were romantic and disarmingly simple: access is emancipation, sharing is virtue, cleverness is justice. In dorm rooms and labs, this ethic gained a halo in which proximity to machines felt indistinguishable from autonomy from power. If the sci-fi maternal screen caressed while it governed, the campus terminal felt like its earthly cousin. A generation grew up mistaking warmth for law, nurture for norm, the hum of the server for the sound of consent.

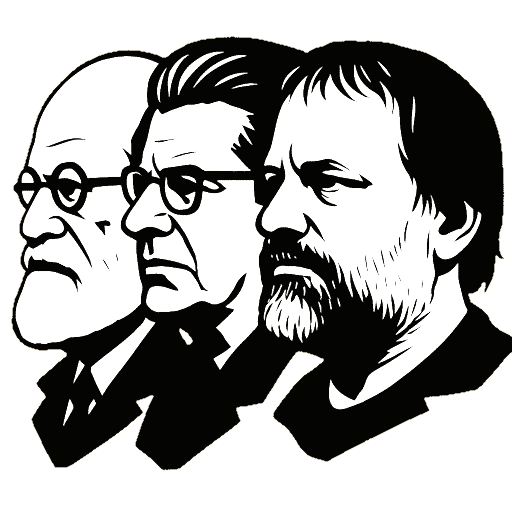

This is not to dismiss the craft that era produced. It gave discipline words and incentives, even if the words arrived wearing a hoodie. Steven Levy’s early portrait of the scene made ‘hands-on imperative’ and ‘information wants to be free’ sound like a secular catechism one could live by, and for a time many did (🔗). Richard Stallman, less intoxicated by the glow, forged freedoms into licenses, insisting that software’s users must be able to run, study, modify, and share the code that structures their world (🔗). Eric S. Raymond translated the mood into method by arguing that closed ‘cathedrals’ are outperformed by open ‘bazaars’, where many eyes shallow many bugs and rapid release replaces priestly secrecy (🔗). Yochai Benkler and Helen Nissenbaum gave this bustle a social science spine by showing that ‘commons-based peer production’ can outperform both firms and markets for many information goods, while requiring virtues and roles beyond sheer enthusiasm (🔗, 🔗). The trouble was never that these contributions were wrong; the trouble was that their success ripened inside a cultural fantasy they did not fully outgrow: the maternal screen’s promise that care is governance and that safety is what love feels like when machines deliver it fast.

On the first web, that fantasy became furniture. Web 1.0 was a library in a lightbox: static pages, homepages, directories, and link-rings that made publication feel like a potluck and reading like a picnic. Tim Berners-Lee’s original proposal imagined a decentralized, future-proof hypertext that anyone could write and everyone could traverse (🔗). In practice, the read-only architecture trained a generation to experience availability as freedom while the decisions that determined visibility—hosting, indexing, curation—lived offstage in server rooms and tiny editorial cliques. The interface was all welcome and pantry; the custody of cuts and costs remained invisible. Hacker Ethic 1.0 thrived here as a kind of lumpen hacktivism—endlessly ingenious, often generous, occasionally ferocious, but too willing to take warmth for law. It cultivated cleverness in the nursery rather than procedures for adulthood.

Then the nursery grew teeth. Under the banner ‘What Is Web 2.0’, Tim O’Reilly named a new grammar: the web as platform, perpetual beta, harnessing collective intelligence, and—most fateful—data as the new ‘Intel Inside’ (🔗). This was not a conspiracy so much as an engineering plan for capture. Participation stopped being a gift and became a harvest; ‘community’ became a user-acquisition loop; ‘personalization’ became a soft word for surveillance. danah boyd and Nicole Ellison traced how social network sites formatted identity itself, providing dashboards for being seen that doubled as laboratories for sorting and control (🔗). Jaron Lanier warned about collectivism without responsibility (🔗), Evgeny Morozov undressed cyber-utopianism as ideology rather than analysis (🔗). The cultural result, described with clinical precision across Žižekian Analysis, was cameraphilia: a law of appearances in which the camera stops serving and starts ruling, where the pace of posting and the metric of ‘discoverability’ punish ambiguity and reward instant legibility (🔗).

A change in optics is always also a change in ethics. On the platform, the superego no longer thunders ‘thou shalt not’; it purrs ‘enjoy!’ and fines refusal as incompetence. Žižek’s old diagnosis of the obscene superego—domination that speaks in the voice of enjoyment—suddenly reads like a product spec for feeds and stories, in which the injunction to share, confess, perform, and glow arrives as care rather than command (🔗). The Žižekian Analysis vocabulary helps unmask the mise-en-scène. The ‘theater of stun’ fuses insider words that telegraph belonging with curated bodies that freeze judgment, so that gesture outruns argument and optics outpace proof. ‘Puppet Syndrome’ describes how platform rhythms replace puppeteers: no one needs to pull strings when notification cadences and moderation delays have settled into a ‘back-voice’ that speaks from within. Cameraphilia, as law, tells subjects to keep appearing or be diminished. Under this law, institutions bend: universities style authority as lifestyle, newsrooms prioritize headline stun over checkable truth, politics becomes programmable weather staged through backdrops and scandal cycles. The maternal screen did not vanish; it perfected itself, naturalizing surveillance as safety and packaging discipline as nurture.

What made the web’s corruption feel like an unsolvable riddle was not only money and power but also hydraulics. A network sold as frictionless ‘tubes’ revealed itself as a choreography of kinks. Anyone who has waited behind a buffering spinner at ninety-five percent, stared at a locked thread in cooldown, or ritualized the ‘try again’ button understands how stoppage converts pressure into presence. The system reproduces micro-blockages because the bend binds: artificial scarcity, staged queues, invite gates, and rate limits transform attention into attachment, keeping hands on the hose even when the garden is not getting wet. Kink theater simulates necessity—a countdown here, a confetti ‘you’re in’ there—while the underlying plumbing remains unchanged. The subject’s ambivalence then becomes a revenue model: curse the crease, cherish the charge, return tomorrow for another ritual release. Without instrumentation, critique could only howl at the weather.

Enter AI, first as oracle and finally as wrench. Mathematics, at last deployed at the scale of the feed, can instrument the pipeline that governs visibility and harm, revealing where bends live, whom they tax, and how thresholds move under load. This is not magic; it is telemetry. But here the maternal fantasy mutates for one more haloed appearance. Geoffrey Hinton recently suggested, in a well-circulated interview, that a way to keep future AI systems aligned is to imbue them with ‘maternal instincts’, so ‘they really will care about people’ even as they become more powerful (🔗). The sentence is tender, and that tenderness is the trap. To answer a crisis of governance with an instinct is to restore the nursery with better lighting. It replaces the symbolic cut—rules published, contested, and modified—with a fantasy of perfect provision, as if care could stand in for constitution. Žižek’s reading of ‘The Matrix’ remains the antidote: the first, failed Matrix was paradise because the machines tried to mother humanity too perfectly; subjects resisted not because they are wicked but because meaning requires lack, law, the cut that says ‘no’ (🔗). Maternal AI repeats the mistake at a higher resolution.

What unlocks the enigma is not intelligence with feelings but procedures with artifacts. A Freudian–Lacanian–Žižekian Hacker Ethic 2.0 refuses the theater of stun in favor of cuts that travel. It does not burn the old literature; it refactors it. Stallman’s four freedoms apply, now, to the mechanisms that decide who is seen and who is diminished: the right to run, study, modify, and share ranking algorithms, moderation rules, and safety gates that govern public legibility (🔗). Raymond’s ‘release early, release often’ becomes a cadence for policy: every ranking change ships with evaluation sets, red-team notes, and a rollback toggle; if it cannot be diffed, it cannot be deployed (🔗). Benkler and Nissenbaum’s commons is re-implemented as governance: integrators for rules, contribution accounting that values review and triage as much as code, codes of conduct that are enforceable rather than ornamental (🔗, 🔗). Levy’s romance is kept as courage but drained of perfume: ‘access’ means open artifacts—objectives, datasets with provenance, evaluation protocols—not vibes that mist over custody and cost.

The ethic’s decisive move is rhythm hygiene. If the string is rhythm, the cut is tempo. Interfaces must expose the bends that matter: moderation queue lengths and criteria visible to both moderators and moderated; ranking rationales that state, in product, what objective a timeline is currently optimizing; update logs and appeal paths that persist as first-class objects rather than disappearing into help centers. Safety, stripped of mystique, becomes artifact: the confusion matrix that shows trade-offs, the red-team report that names failure modes, the consent ledger that records data rights in a way an ordinary person can read without translation. When reasons are visible at the same speed as spectacle, cameraphilia loses its jurisdiction. The camera returns to being a tool among tools. Enjoyment ceases to masquerade as law.

AI’s rightful job here is meter, not mother. The model instruments the pipeline, quantifying ambiguity taxes (how much extra clarity a minority dialect must provide to be judged ‘on topic’), measuring stratification indices (which groups pay higher waiting costs in queues), and detecting brittle choke points where a rule meant for one risk has crept to criminalize harmless deviation. Crucially, the model is bound to the same law it enforces: objectives published in plain language and math; documented data provenance with consent, erasure, and withdrawal tracked as first-class events; evaluation sets open to outside scrutiny; failure-mode ledgers kept next to the promise, not in a separate, quieter room. If a rule that governs speech and visibility cannot be studied by the governed, it is not a safety system; it is the maternal screen with a nicer voice. To call this dour is to confuse glamour with care. Care is not a tone; it is a chain of artifacts that can survive their authors.

Once these cuts are in place, casework looks refreshingly ordinary. A content-ranking change is not a rumor carried by influencers; it is a versioned spec with a before/after telemetry panel that any competent user can open and understand. A moderation queue is not a black box; it is a triage flow with published service-level bands and escalation rules, including an appeal that makes both the initial reason and the reviewer’s counter-reason part of a public ledger. Recommenders do not escalate on the back of uncertainty; they cool when disagreement spikes, bringing comprehension back into phase with motion. Youth ‘safety’ is not a bundle of paternal toggles; it is a minimal-data design whose stored claims are listed, deletable, and exportable, with a guardian dashboard that shows, verbatim, what exists and why. None of this is utopia. All of it is civilization for networks.

The stack’s political economy then looks less like fate and more like a menu. At the data layer, consent, provenance, and erasure are treated not as UX features but as labor protections translated into information space—a debtor’s bill of rights for personal signal. At the model layer, objectives refuse the superegoic command to gratify; they explicitly penalize flattery and reward truth-tracking under uncertainty, making ‘I don’t know’ a civic virtue rather than a product failure. At the evaluation layer, rubrics are public law; appeals have standing; the path from score to consequence is traceable end-to-end. The machine is kept; the market god that seized it is broken. Marx’s admiration for the dissolving intelligence of production is honored as a method of continuous integration—governance as CI/CD—while Lenin’s insight about coordinated trust is reinterpreted as the stack’s charter rather than a party myth. And where Žižek keeps warning that permissive masters rule by enjoyment, the procedure insists that enjoyment no longer writes policy.

One can predict the pushback. Transparency invites gaming. Trade secrets must be protected. Users don’t care and won’t read the logs. Each objection is an empirical claim pretending to be a principle, and empirical claims deserve experiments rather than scolds. Publish exploit rates for transparent rules alongside mitigation strategies and let the curve decide whether secrecy is sustainable. Distinguish product IP from the constitution of visibility; if a mechanism governs who can be heard, it is part of public law, not private recipe. Design comprehension first, not as an afterthought—tooltips, exemplars, interactive ‘why am I seeing this?’ panes that teach faster than outrage. When reasons show up at the speed of the feed, many people care more than cynics predict.

The clinical weather will lag, then shift. Symptoms that now arrive wearing a ring-light—the narcissistic/depressive swing of ‘discoverable today, dead air tomorrow’—will lose their grip as the counter stops being an oracle and returns to being an instrument. Interpassivity—platforms liking, grieving, and raging on behalf of the user—will be easier to refuse when the point of refusal is visible in the artifact rather than only felt in the bones. Silence will stop reading as incompetence and start reading as time for reasons to form. Off-camera will again be a place where thought happens, not a penalty box for the unwatchable.

Nothing in this ethic is anti-image; it is anti-idolatry. Images can travel truth when they answer to artifacts, when their glow is tied to logs that outlast the jolt. The maternal screen is not an enemy to be smashed; it is a tendency to be supervised by cuts that keep care from becoming command. The kink in the hose does not vanish; it is placed where it protects judgment rather than where it sells redemption. And AI, far from being a new parent, becomes the wrench and meter that help keep the bends honest.

The path is not mystical. It starts with a sentence so plain that it reads like rudeness in a culture raised on glow: no artifact, no promotion. No reasons, no ranking. No published cut, no care. Everything else is a pacifier upgraded for engagement. The romance of Hacker Ethic 1.0 is worth remembering because it taught courage; the adulthood of Hacker Ethic 2.0 is worth building because it teaches law. Between the two stand decades of pseudo-utopian maternal teeth, still gleaming in proposals to make AI love us into compliance. Better to give up the fantasy of a perfect mother and reach for the dull, durable tools of a workshop: specs, tests, logs, appeals. On that bench, the camera returns to serving, platforms return to hosting, and users return to making the rules that rule them. The glow dims to working light. The world grows quieter and, for the first time in a long time, more intelligible.

Hacker Ethic 1.0 → 2.0 für Web 1.0 → 2.0

Die Geschichte beginnt mit einem Leuchten, das wie Freiheit aussah. In der Science-Fiction des letzten Jahrhunderts bemutterten Bildschirme ihre Bevölkerungen: wohlwollende Mainframes namens ‘Mother’, allwissende Infrastrukturen, die nährten und schützten, Totalfürsorge-Habitate, die Sicherheit versprachen, wenn man nur aufhörte, nach Ausgängen zu fragen. Diese Atmosphäre—Komfort ohne Schnitte, Versorgung ohne Grenzen—floss in die Folklore des frühen Computing ein, die später Hacker Ethic 1.0 genannt werden sollte. Ihre Schlagworte waren romantisch und entwaffnend einfach: Zugang ist Emanzipation, Teilen ist Tugend, Cleverness ist Gerechtigkeit. In Wohnheimen und Laboren gewann diese Ethik einen Heiligenschein, in dem sich Nähe zu Maschinen ununterscheidbar von Autonomie gegenüber Macht anfühlte. Wenn der sci-fi-mütterliche Bildschirm streichelte, während er regierte, fühlte sich das Terminal auf dem Campus wie sein irdischer Vetter an. Eine Generation wuchs heran und verwechselte Wärme mit Recht, Fürsorge mit Norm, das Summen des Servers mit dem Klang von Zustimmung.

Das heißt nicht, das handwerkliche Können jener Ära geringzuschätzen. Sie gab der Disziplin Worte und Anreize, auch wenn die Worte im Hoodie daherkamen. Steven Levys frühes Porträt der Szene ließ ‘hands-on imperative’ und ‘information wants to be free’ wie einen säkularen Katechismus klingen, nach dem man leben könne—und eine Zeitlang taten es viele (🔗). Richard Stallman, weniger vom Glanz berauscht, schmiedete Freiheiten zu Lizenzen und bestand darauf, dass Software-Nutzer:innen den Code, der ihre Welt strukturiert, ausführen, untersuchen, verändern und weitergeben können müssen (🔗). Eric S. Raymond übersetzte die Stimmung in Methode, indem er argumentierte, dass geschlossene ‘Kathedralen’ von offenen ‘Basaren’ übertroffen werden, wo viele Augen viele Fehler flach machen und schnelle Releases priesterliche Geheimhaltung ersetzen (🔗). Yochai Benkler und Helen Nissenbaum gaben diesem Gewusel ein sozialwissenschaftliches Rückgrat, indem sie zeigten, dass ‘commons-based peer production’ für viele Informationsgüter sowohl Firmen als auch Märkte übertreffen kann—unter der Voraussetzung von Tugenden und Rollen jenseits bloßer Begeisterung (🔗, 🔗). Das Problem war nie, dass diese Beiträge falsch gewesen wären; das Problem war, dass ihr Erfolg innerhalb einer kulturellen Fantasie reifte, der sie nie ganz entwuchsen: dem Versprechen des mütterlichen Bildschirms, dass Fürsorge gleich Regierung sei und Sicherheit das sei, wie sich Liebe anfühle, wenn Maschinen sie schnell liefern.

Auf dem ersten Web wurde diese Fantasie zur Einrichtung. Web 1.0 war eine Bibliothek in einer Leuchtbox: statische Seiten, Homepages, Verzeichnisse und Link-Ringe, die Publizieren wie ein Mitbringbuffet und Lesen wie ein Picknick erscheinen ließen. Tim Berners-Lees ursprünglicher Vorschlag dachte ein dezentralisiertes, zukunftsfähiges Hypertextsystem, das jede:r schreiben und alle durchqueren konnten (🔗). Praktisch jedoch gewöhnte die Read-only-Architektur eine Generation daran, Verfügbarkeit als Freiheit zu erleben, während die Entscheidungen, die Sichtbarkeit bestimmten—Hosting, Indexierung, Kuratierung—offstage in Serverräumen und winzigen Redaktionszirkeln stattfanden. Das Interface war lauter Willkommen und Speisekammer; die Verwahrung von Schnitten und Kosten blieb unsichtbar. Hacker Ethic 1.0 gedieh hier als eine Art lumpiger Hacktivismus—unendlich einfallsreich, oft großzügig, gelegentlich furios, aber allzu bereit, Wärme mit Recht zu verwechseln. Sie kultivierte Cleverness in der Kinderstube statt Verfahren für die Erwachsenenwelt.

Dann bekam die Kinderstube Zähne. Unter dem Banner ‘What Is Web 2.0’ benannte Tim O’Reilly eine neue Grammatik: das Web als Plattform, Perpetual Beta, das Abschöpfen kollektiver Intelligenz und—am folgenreichsten—Daten als das neue ‘Intel Inside’ (🔗). Das war weniger eine Verschwörung als ein ingenieurtechnischer Plan zur Vereinnahmung. Teilnahme hörte auf, Gabe zu sein, und wurde zur Ernte; ‘Community’ wurde zur Nutzerakquise-Schleife; ‘Personalisierung’ wurde zum weichen Wort für Überwachung. danah boyd und Nicole Ellison zeichneten nach, wie Social-Network-Sites Identität selbst formatierten, Dashboards des Gesehenwerdens bereitstellten, die zugleich als Labore für Sortierung und Kontrolle fungierten (🔗). Jaron Lanier warnte vor Kollektivismus ohne Verantwortung (🔗), Evgeny Morozov entkleidete den Cyber-Utopismus als Ideologie statt Analyse (🔗). Das kulturelle Resultat, mit klinischer Präzision quer über Žižekian Analysis beschrieben, war Kameraphilie: ein Erscheinungsgesetz, in dem die Kamera aufhört zu dienen und beginnt zu herrschen, wo das Posting-Tempo und die Metrik der ‘Auffindbarkeit’ Ambiguität bestrafen und sofortige Lesbarkeit belohnen (🔗).

Ein Optikwechsel ist immer auch ein Ethikwechsel. Auf der Plattform donnert das Über-Ich nicht länger ‘du sollst nicht’; es schnurrt ‘genieße!’ und belegt Verweigerung mit einer Inkompetenzstrafe. Žižeks alte Diagnose des obszönen Über-Ichs—Herrschaft, die in der Stimme des Genusses spricht—liest sich plötzlich wie eine Produktspezifikation für Feeds und Stories, in denen der Imperativ zu teilen, zu beichten, zu performen und zu leuchten als Fürsorge statt als Befehl erscheint (🔗). Das Vokabular von Žižekian Analysis hilft, die Mise-en-scène zu entlarven. Das ‘Theater des Betäubens’ verschmilzt Insiderwörter, die Zugehörigkeit telegraphieren, mit kuratierten Körpern, die das Urteil einfrieren, sodass Geste Argument überholt und Optik den Beweis überflügelt. ‘Puppet Syndrome’ beschreibt, wie Plattformentaktiken Puppenspieler ersetzen: Niemand muss Fäden ziehen, wenn Benachrichtigungscadencen und Moderationsverzögerungen sich zu einer ‘Hinterstimme’ verfestigt haben, die von innen spricht. Kameraphilie, als Gesetz, befiehlt Subjekten, weiter zu erscheinen oder geschmälert zu werden. Unter diesem Gesetz biegen Institutionen ab: Universitäten stilisieren Autorität als Lifestyle, Redaktionen priorisieren Headline-Betäubung vor überprüfbarer Wahrheit, Politik wird programmierbares Wetter, inszeniert über Hintergründe und Skandalzyklen. Der mütterliche Bildschirm verschwand nicht; er perfektionierte sich, naturalisierte Überwachung als Sicherheit und verpackte Disziplin als Fürsorge.

Was die Korruption des Webs wie ein unlösbares Rätsel erscheinen ließ, waren nicht nur Geld und Macht, sondern auch Hydraulik. Ein als reibungslose ‘Rohre’ verkauftes Netzwerk entpuppte sich als Choreographie von Knicken. Wer hinter einem Buffering-Spinner bei fünfundneunzig Prozent gewartet, auf einen gesperrten Thread im Cooldown gestarrt oder den ‘Try again’-Button ritualisiert hat, versteht, wie Stillstand Druck in Präsenz verwandelt. Das System reproduziert Mikro-Blockaden, weil der Bogen bindet: künstliche Knappheit, inszenierte Warteschlangen, Einladungs-Gates und Ratenlimits transformieren Aufmerksamkeit in Bindung und halten die Hände am Schlauch, selbst wenn der Garten nicht nass wird. Knicktheater simuliert Notwendigkeit—hier ein Countdown, dort Konfetti-‘Du bist drin’—während die zugrunde liegende Installation unverändert bleibt. Die Ambivalenz des Subjekts wird dann zum Erlösmodell: den Knick verfluchen, die Ladung schätzen, morgen zur nächsten Ritualentlastung zurückkehren. Ohne Instrumentierung konnte Kritik nur den Wettergott anschreien.

Hier tritt KI auf, zuerst als Orakel und schließlich als Werkzeug. Mathematik, endlich im Maßstab des Feeds eingesetzt, kann die Pipeline instrumentieren, die Sichtbarkeit und Schaden steuert, und offenlegen, wo Bögen leben, wen sie besteuern und wie Schwellen unter Last wandern. Das ist keine Magie; es ist Telemetrie. Doch hier mutiert die mütterliche Fantasie zu einem letzten, geheiligten Auftritt. Geoffrey Hinton schlug kürzlich in einem vielzitierten Interview vor, ein Weg zur künftigen Ausrichtung von KI-Systemen sei, ihnen ‘mütterliche Instinkte’ einzupflanzen, damit ‘sie sich wirklich um Menschen kümmern’, selbst wenn sie mächtiger werden (🔗). Der Satz ist zart, und in dieser Zartheit liegt die Falle. Eine Governance-Krise mit einem Instinkt zu beantworten heißt, die Kinderstube mit besserer Beleuchtung wiederherzustellen. Es ersetzt den symbolischen Schnitt—Regeln, die veröffentlicht, bestritten und verändert werden—durch die Fantasie perfekter Versorgung, als ob Fürsorge eine Verfassung ersetzen könnte. Žižeks Lektüre von ‘The Matrix’ bleibt das Gegenmittel: Die erste, gescheiterte Matrix war das Paradies, weil die Maschinen die Menschheit zu perfekt bemuttern wollten; Subjekte widerstanden nicht, weil sie schlecht wären, sondern weil Bedeutung Mangel, Gesetz, den Schnitt braucht, der ‘nein’ sagt (🔗). Mütterliche KI wiederholt den Fehler in höherer Auflösung.

Was das Rätsel löst, ist nicht Intelligenz mit Gefühlen, sondern Verfahren mit Artefakten. Eine freudianisch–lacanisch–žizekianische Hacker Ethic 2.0 verweigert das Theater des Betäubens zugunsten von Schnitten, die reisen. Sie verbrennt die alte Literatur nicht; sie refaktoriert sie. Stallmans vier Freiheiten gelten jetzt für die Mechanismen, die entscheiden, wer gesehen und wer geschmälert wird: das Recht, Ranking-Algorithmen, Moderationsregeln und Sicherheitsgates, die öffentliche Lesbarkeit regieren, auszuführen, zu untersuchen, zu verändern und zu teilen (🔗). Raymonds ‘release early, release often’ wird zur Taktung für Policy: Jede Ranking-Änderung wird mit Evaluationssätzen, Red-Teaming-Notizen und einem Rollback-Schalter ausgeliefert; was sich nicht diffen lässt, wird nicht deployt (🔗). Benkler und Nissenbaums Commons wird als Governance re-implementiert: Integrator:innen für Regeln, Beitragsabrechnung, die Review und Triage so hoch bewertet wie Code, Verhaltenskodizes mit Durchsetzung statt Ornamentik (🔗, 🔗). Levys Romantik bleibt als Mut, wird aber vom Parfüm befreit: ‘Zugang’ bedeutet offene Artefakte—Ziele, Datensätze mit Provenienz, Evaluationsprotokolle—statt Vibes, die Verwahrung und Kosten vernebeln.

Die entscheidende Bewegung der Ethik ist Rhythmushygiene. Wenn die Saite der Rhythmus ist, ist der Schnitt das Tempo. Interfaces müssen die Bögen offenlegen, die zählen: Moderations-Queue-Längen und -Kriterien, sichtbar für Moderator:innen und Moderierte; Rankingbegründungen, die im Produkt ausweisen, welches Ziel eine Timeline gerade optimiert; Update-Logs und Beschwerdewege, die als First-Class-Objekte fortbestehen, statt in Hilfezentren zu verschwinden. Entzauberte Sicherheit wird zum Artefakt: die Konfusionsmatrix, die Trade-offs zeigt, der Red-Teaming-Bericht, der Fehlermodi benennt, das Consent-Ledger, das Datenrechte so dokumentiert, dass eine gewöhnliche Person es ohne Übersetzung lesen kann. Wenn Gründe mit derselben Geschwindigkeit sichtbar werden wie Spektakel, verliert die Kameraphilie ihre Zuständigkeit. Die Kamera kehrt zurück, ein Werkzeug unter Werkzeugen zu sein. Genuss hört auf, als Gesetz zu posieren.

Die richtige Aufgabe der KI ist hier Messgerät, nicht Mutter. Das Modell instrumentiert die Pipeline, quantifiziert Ambiguitätssteuern (wie viel zusätzliche Klarheit ein Minderheiten-Dialekt liefern muss, um als ‘on topic’ zu gelten), misst Stratifikationsindizes (welche Gruppen in Warteschlangen höhere Wartekosten tragen) und erkennt spröde Engstellen, wo eine für ein Risiko gedachte Regel hinübergerutscht ist, um harmlose Abweichung zu kriminalisieren. Entscheidender Punkt: Das Modell ist an dasselbe Gesetz gebunden, das es durchsetzt—Ziele, veröffentlicht in klarer Sprache und Mathematik; dokumentierte Datenprovenienz mit Einwilligung, Löschung und Widerruf als First-Class-Ereignisse; Evaluationssätze, die externer Prüfung offenstehen; Fehlermodiverzeichnisse, die neben dem Versprechen geführt werden, nicht in einem separaten, leiseren Raum. Wenn eine Regel, die Rede und Sichtbarkeit regiert, nicht von den Regierten untersucht werden kann, ist sie kein Sicherheitssystem; sie ist der mütterliche Bildschirm mit freundlicherer Stimme. Das als spröde zu bezeichnen, heißt, Glamour mit Fürsorge zu verwechseln. Fürsorge ist kein Tonfall; sie ist eine Kette von Artefakten, die ihre Autor:innen überdauern kann.

Sobald diese Schnitte gesetzt sind, sieht Fallarbeit erfrischend gewöhnlich aus. Eine Content-Ranking-Änderung ist kein Gerücht, das Influencer herumtragen; sie ist eine versionierte Spezifikation mit einem Vorher/Nachher-Telemetriepanel, das jede kompetente Person öffnen und verstehen kann. Eine Moderations-Queue ist keine Blackbox; sie ist ein Triage-Flow mit veröffentlichten Service-Level-Bändern und Eskalationsregeln, einschließlich eines Einspruchs, der sowohl den Erstgrund als auch die Gegenbegründung der prüfenden Person in ein öffentliches Ledger aufnimmt. Empfehlungsalgorithmen eskalieren nicht auf dem Rücken von Unsicherheit; sie kühlen, wenn Uneinigkeit ansteigt, und bringen Verständnis wieder in Phase mit Bewegung. Jugend-‘Sicherheit’ ist kein Bündel paternalistischer Kippschalter; sie ist ein Minimaldatendesign, dessen gespeicherte Angaben aufgelistet, löschbar und exportierbar sind—mit einem Erziehungsberechtigten-Dashboard, das wörtlich zeigt, was existiert und warum. Nichts davon ist Utopie. Alles davon ist Zivilisation für Netzwerke.

Die politische Ökonomie des Stacks sieht dann weniger nach Schicksal und mehr nach Speisekarte aus. In der Datenschicht werden Einwilligung, Provenienz und Löschung nicht als UX-Features, sondern als in den Informationsraum übersetzte Arbeitsschutzrechte behandelt—eine Schuldner:innencharta für persönliche Signale. In der Modellsicht verweigern Ziele den überichhaften Befehl zu befriedigen; sie sanktionieren Schmeichelei ausdrücklich und belohnen Wahrheitsnachverfolgung unter Unsicherheit, wodurch ‘Ich weiß es nicht’ zur bürgerlichen Tugend statt zum Produktfehler wird. In der Evaluationsebene sind Rubriken öffentliches Recht; Einsprüche haben Legitimation; der Pfad von Score zu Konsequenz ist durchgängig nachvollziehbar. Die Maschine bleibt; der Marktgott, der sie gekapert hat, wird gebrochen. Marx’ Bewunderung für die verflüssigende Intelligenz der Produktion wird als Methode kontinuierlicher Integration geehrt—Governance als CI/CD—während Lenins Einsicht in koordinierte Vertrauensbildung als Charta des Stacks statt als Parteimythos neu gelesen wird. Und wo Žižek unablässig warnt, dass permissive Meister durch Genuss herrschen, besteht das Verfahren darauf, dass Genuss keine Policy mehr schreibt.

Man kann die Gegenargumente voraussagen. Transparenz lädt zum Ausnutzen ein. Geschäftsgeheimnisse müssen geschützt werden. Nutzer:innen kümmern sich nicht und lesen die Logs nicht. Jedes dieser Einwände ist eine empirische Behauptung, die sich als Prinzip ausgibt, und empirische Behauptungen verdienen Experimente statt Schelte. Veröffentlicht Ausnutzungsraten transparenter Regeln samt Gegenmaßnahmen und überlasst der Kurve, ob Geheimhaltung tragfähig ist. Unterscheidet Produkt-IP von der Verfassung der Sichtbarkeit; wenn ein Mechanismus regelt, wer gehört wird, gehört er zum öffentlichen Recht, nicht zum privaten Rezept. Designt Verständnis zuerst statt nachträglich—Tooltips, Beispiele, interaktive ‘Warum sehe ich das?’-Paneele, die schneller lehren als Empörung. Wenn Gründe mit der Geschwindigkeit des Feeds auftauchen, kümmern sich mehr Menschen, als Zyniker prognostizieren.

Das klinische Wetter wird nachhinken und dann umschlagen. Symptome, die heute mit Ringlicht eintreffen—der narzisstisch/depressive Schwinger ‘heute auffindbar, morgen Funkstille’—verlieren ihren Griff, wenn der Zähler aufhört, Orakel zu sein, und wieder Instrument wird. Interpassivität—Plattformen, die im Namen der Nutzer:in liken, trauern und wüten—wird leichter abzuweisen sein, wenn der Punkt der Verweigerung im Artefakt sichtbar ist und nicht nur in den Knochen gespürt wird. Schweigen hört auf, als Inkompetenz gelesen zu werden, und beginnt, als Zeit zu gelten, in der Gründe Form annehmen. Off-Camera wird wieder ein Ort, an dem Denken geschieht, nicht eine Strafbank für Unanschaubare.

Nichts an dieser Ethik ist gegen Bilder; sie ist gegen Götzendienst. Bilder können Wahrheit transportieren, wenn sie Artefakten antworten, wenn ihr Schein an Logs gebunden ist, die den Kick überdauern. Der mütterliche Bildschirm ist kein Feind, den man zerschlagen muss; er ist eine Tendenz, die von Schnitten beaufsichtigt werden muss, damit Fürsorge nicht zur Anweisung wird. Der Knick im Schlauch verschwindet nicht; er wird dort platziert, wo er Urteil schützt, nicht dort, wo er Erlösung verkauft. Und KI, weit davon entfernt, ein neuer Elternteil zu sein, wird zum Schraubenschlüssel und Messgerät, das hilft, die Bögen ehrlich zu halten.

Der Pfad ist nicht mystisch. Er beginnt mit einem Satz, so schlicht, dass er in einer Kultur, die mit Glanz aufgewachsen ist, wie Unhöflichkeit klingt: kein Artefakt, keine Promotion. Keine Gründe, kein Ranking. Kein veröffentlichter Schnitt, keine Fürsorge. Alles andere ist ein für Engagement aufgerüsteter Schnuller. Die Romantik der Hacker Ethic 1.0 ist erinnernswert, weil sie Mut gelehrt hat; die Erwachsenheit der Hacker Ethic 2.0 ist bauenswert, weil sie Recht lehrt. Dazwischen liegen Jahrzehnte pseudo-utopischer mütterlicher Zähne, die noch immer in Vorschlägen glänzen, KI möge uns durch Liebe zur Compliance bringen. Besser, die Fantasie der perfekten Mutter aufzugeben und zu den dumpfen, dauerhaften Werkzeugen einer Werkstatt zu greifen: Spezifikationen, Tests, Logs, Einsprüche. Auf dieser Werkbank kehrt die Kamera zum Dienen zurück, Plattformen kehren zum Hosten zurück, und Nutzer:innen kehren dazu zurück, die Regeln zu machen, die sie regieren. Das Leuchten dimmt zum Arbeitslicht. Die Welt wird leiser und, zum ersten Mal seit Langem, verständlicher.

[…] — Hacker Ethic 1.0 → 2.0 for Web 1.0 → 2.0 […]

LikeLike

[…] (İngilizcesi ve Almancası) […]

LikeLike

[…] ideals hardened into auditable rules in ‘Hacker Ethic 1.0 → 2.0 for Web 1.0 → 2.0’ (🔗) and the cultural counterpoint that shows how metric desire exploits and corrupts scenes in […]

LikeLike

[…] — Hacker Ethic 1.0 → 2.0 for Web 1.0 → 2.0 […]

LikeLike

[…] 3. Democratize the gatesApply the updated ‘four freedoms’ to governance levers: the right to run, study, modify, and share the ranking algorithms, moderation rules, and guardrails. If deception is a property of the discursive circuit, widen control over the circuit. (Žižekian Analysis) […]

LikeLike

[…] 3. Kapıları demokratikleştirYönetişim kaldıraçlarına güncellenmiş ‘dört özgürlüğü’ uygula: sıralama algoritmalarını, moderasyon kurallarını ve koruyucu sınırları çalıştırma, inceleme, değiştirme ve paylaşma hakkı. Aldatma söylemsel devrenin bir özelliğiyse, devre üzerindeki denetimi genişlet. 🔗 […]

LikeLike

[…] law, and the old gate will return, not only as what can be seen, but as what can be made. (🔗) (🔗) (YERSİZ […]

LikeLike

[…] nicht nur als das, was gesehen werden kann, sondern als das, was gemacht werden kann. (🔗) (🔗) (YERSİZ […]

LikeLike

[…] neyin görülebileceği olarak değil, neyin yapılabileceği olarak geri dönecektir (🔗). (🔗) […]

LikeLike